AI, 이미 인간의 이해 범위 넘어섰다

'머신러닝' 기술로 개발자 벗어나 자체 습득한 정보 많기 때문

진단 어려운 병도 정확히 예측하지만 그 원리는 아무도 몰라

전문가 "AI 성능 높아질수록 이해하기 어려워져"

기술은 발전하지만 AI 결정 어떻게 해석하고 다룰지 논의 부족

EU, AI의 결정에 설명 요구할 권리 명시한 법 내년부터 시행

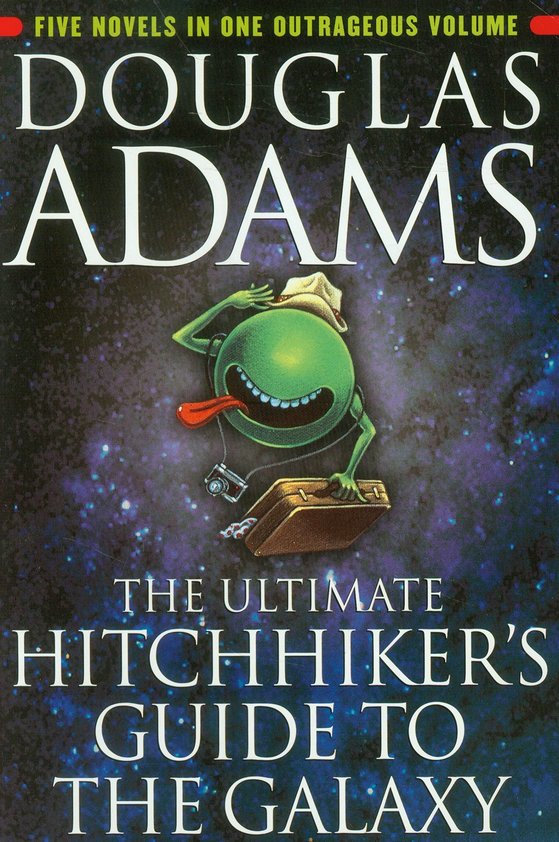

이제는 고전이 된 영국 작가 더글러스 애덤스의 SF소설 『은하수를 여행하는 히치하이커를 위한 안내서』에 등장하는 한 외계 종족은 삶과 우주, 세상 만물에 대한 답을 구하기 위해 슈퍼컴퓨터 '딥소트(Deep Thought, 깊은 생각)'를 개발한다. 너무 방대해 그 크기가 작은 도시에 맞먹는 딥소트는 750만 년에 걸친 연산 끝에 다음과 같은 결론을 내린다. "삶과 우주, 세상 모든 것에 대한 질문의 답은 42입니다."(위 영상은 이 소설을 소재로 한 영화의 한 장면)

'이해할 수 없는 AI'를 가장 명확하게 보여준 사례는 구글 딥마인드의 바둑 AI 알파고다. 알파고는 지난해 3월 한국 바둑기사 이세돌 9단과 5전을 벌여 4승 1패로 압승을 거둔 데 이어 박정환 9단, 커제 9단 등 한·중·일 초일류 프로기사와의 온라인 대국에서 60전 60승을 거뒀다.

![세계 바둑 최강자로 꼽히는 중국의 커제가 지난 5월 알파고와의 대국 도중 승산이 보이지 않자 울먹이고 있다. [연합뉴스]](https://img3.daumcdn.net/thumb/R658x0.q70/?fname=http://t1.daumcdn.net/news/201707/26/joongang/20170726110101207lkxi.jpg)

딥 패이션트는 너무나도 뛰어난 나머지 의료진의 이해조차도 넘어서고 말았다. 딥 패이션트는 조현병 등 초기 진단이 어렵기로 악명 높은 정신질환까지도 정확하게 예측해냈지만, 그게 어떻게 가능했는지는 아무도 알 수 없었던 것이다. 딥 패이션트의 개발과 운영을 총괄한 생명공학자 조엘 더들리는 "우리는 모델을 만들 수 있지만 그 모델이 어떻게 작동하는지는 알 수 없다"고 밝혔다.

이 같은 현상이 나타나는 이유는 오늘날 AI 기술의 핵심이 스스로 학습하는 머신러닝 기술에 있기 때문이다. 과거엔 개발자가 프로그램에 필요한 모든 내용들을 일일히 손으로 입력했고, 그렇기 때문에 그 프로그램이 개발자의 이해를 넘어서는 일은 발생하지 않았다.

![지난해 6월 일본 프로 쇼기 기사 야마사키 다카유키(山崎隆之)가 인공지능 포난자와 대국을 벌이고 있다. [유튜브 캡처]](https://img3.daumcdn.net/thumb/R658x0.q70/?fname=http://t1.daumcdn.net/news/201707/26/joongang/20170726110101373akls.jpg)

야마모토는 서로 다른 버전의 포난자들끼리 3000회 가량 대국을 시키고, 이 대국 통계를 분석해 더 나은 포난자의 프로그램을 채택하는 방식으로 포난자를 개량했다. 채택된 포난자는 그렇지 못한 포난자보다 평균 2%p 정도 승률이 높았다고 한다. 대국에서 52%의 승률을 거둔 포난자가 살아남고, 이 포난자가 또 다른 포난자와 대국을 거친다. 처음엔 아마추어보다도 실력이 한참 아래였던 포난자는 이 과정을 반복하면서 인간 최고수도 꺾을 수 있을 만큼 우수해졌다.

야마모토는 왜 한 포난자가 다른 포난자보다 승률이 더 높은지 알지 못한다. 야마모토가 한 일은 프로그램의 구조를 이리저리 바꿔서 대국을 시키고 그 결과를 통계화해 분석하는 것이었으며, AI의 성능을 높이는 데는 그 과정만으로도 충분했기 때문이다. 야마모토는 "AI의 성능을 높일수록 그 성능이 높아지는 이유를 이해할 수 없게 되는 딜레마가 발생한다. 이 딜레마는 이미 AI 개발의 원칙처럼 받아들여지고 있다"며 "AI는 이미 개발자의 품에서 졸업했다. 앞으로 인류는 (알파고에 좌절했던) 프로 기사들과 동일한 경험을 하게 될 것"이라고 설명했다.

![지난 4월 인천 가천대길병원 'IBM 왓슨 인공지능 암센터'에서 의료진이 미국 IBM사의 인공지능 프로그램 '왓슨 포 온콜로지'를 활용해 환자의 진료 계획을 의논하고 있다. [중앙포토]](https://img4.daumcdn.net/thumb/R658x0.q70/?fname=http://t1.daumcdn.net/news/201707/26/joongang/20170726110101531hjut.jpg)

유럽연합(EU)은 지난해 통과시킨 포괄적정보보호법(GDPR)에 AI의 결정으로 인한 피해를 줄이기 위한 안전 장치들을 삽입했다. 이에 따르면 인간은 AI가 단독으로 내린 결정의 주체가 되지 않을 권리, AI가 내린 결정에 대해 설명을 요구할 권리를 갖는다. 이 법은 2년 간의 준비 기간을 거쳐 내년 5월부터 모든 EU 국가에서 시행된다.

영국 옥스퍼드 인터넷 연구소의 브라이스 굿먼 연구원은 "AI의 복잡한 인공 신경망 속에서 학습된 정보들을 과연 어떻게 설명할지에 대한 논의는 머신러닝 연구자들 사이에서도 최근에야 주목을 받기 시작했다"며 "관건은 AI가 단지 효율뿐 아니라 투명성과 공정함까지 갖출 수 있느냐는 것"이라고 지적했다.

그러나 우리가 AI를 투명하게 이해할 길은 앞으로도 영영 없을지 모른다. 제프 클룬 미국 와이오밍대 교수(컴퓨터공학)는 과학기술 전문지 MIT테크놀로지리뷰에 "설령 어떤 사람이 자기가 내린 결정의 이유를 그럴 듯하게 말해주더라도 아마 그 설명은 불완전할 것이다. 이는 AI도 마찬가지"라며 "전부 이성적으로 해명되지 않는 것이 지성의 본성일 수 있다. 이성으로 설명할 수 없는 나머지 부분은 직관적이거나 무의식적이거나 아예 해석이 불가능한 것"이라고 말했다.

이기준 기자 foridealist@joongang.co.kr

Copyright © 중앙일보. 무단전재 및 재배포 금지.